Nous voyons en relief des objets situés relativement prêt de notre visage. Au delà d’une certaine distance (3 ou 4 mètres), les images reçues par nos deux yeux se confondent. C’est surtout l’évolution des images lorsque nous bougeons, qui nous renseigne sur le relief qui nous entoure.

En partant de ce constat, il est facile de créer des pseudo-hologrammes pour une personne donnée : il suffit de connaître la position de ses yeux.

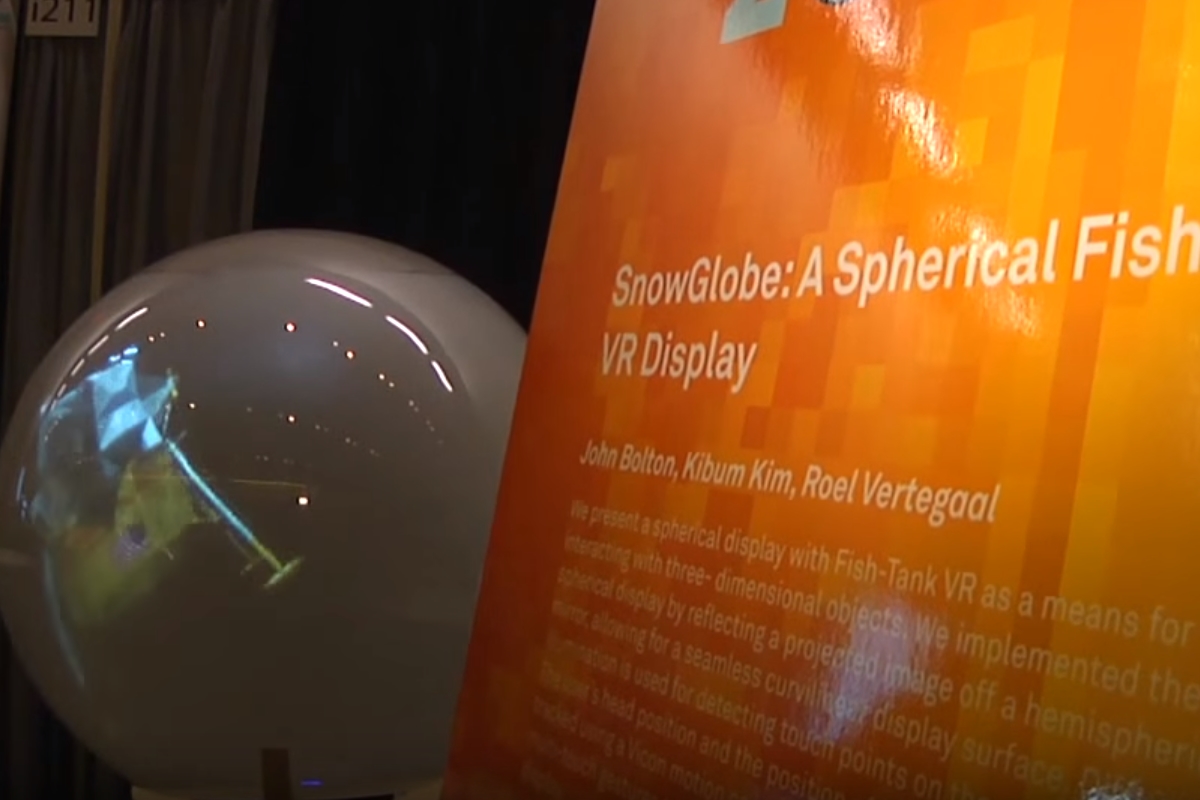

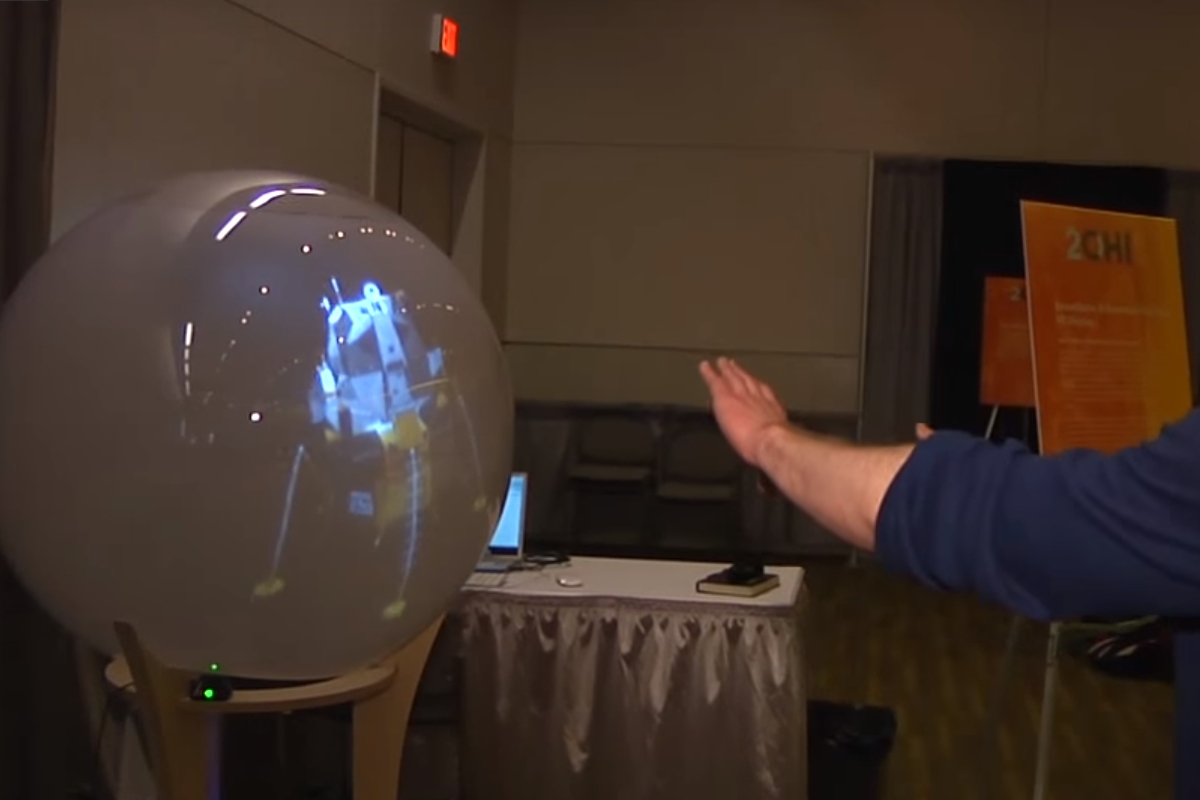

Les étudiants de Queens University ont fait une démonstration d’un tel système avec leur « Snowglobe ». Ils projettent une image sur une sphère et la déforment en fonction de la position de l’observateur le plus proche. La détection était réalisée à l’aide d’une simple Kinect.

Il existe des système de détection plus aboutis, par exemple celui développé par le laboratoire HML pour reproduire un humain à l’échelle 1:1. Il s’agit d’un cylindre de projection 3D, équipé de plusieurs détecteurs de mouvements pour repérer les visages à proximité, et déformer l’image en conséquence. Le système crée ainsi un avatar lors de visio-conférences 3D. La sensation de présence est importante, ce qui manque souvent lors d’un appel sur simple écran 2D.

La vidéo ci-dessous montre également le procédé pour scanner en 3D les interlocuteurs de la visioconférence.

Remarque : j’ai pu tester pendant plusieurs années le pouvoir du tracking sur notre perception du relief dans le cube immersif du centre de réalité virtuelle de Clermont-Ferrand. En effet, il nous arrivait parfois d’oublier d’activer la 3D sur les écrans pour des démonstrations. Et pourtant, les visiteurs avaient toujours l’impression de voir une simulation en relief. En testant le cube immersif sans lunettes, je me suis effectivement aperçu que le tracking était beaucoup plus important que la 3D pour tous les objets situés derrière les écrans, c’est à dire à plus de 2 mètres.